MemGPT-学习-总结

MemGPT: Towards LLMs as Operating Systems

Large language models (LLMs) have revolutionized AI, but are constrained by limited context windows, hindering their utility in tasks like extended conversations and document analysis. To enable using context beyond limited context windows, we propose virtual context management, a technique drawing…

当前,大型语言模型(LLMs)在处理扩展对话和文档分析等任务时受到有限上下文限制,限制了它们在扩展对话和文档分析等任务中的能发挥的作用。如何让大语言模型拥有更强的上下文处理能力是业界非常看重的热点主题之一。

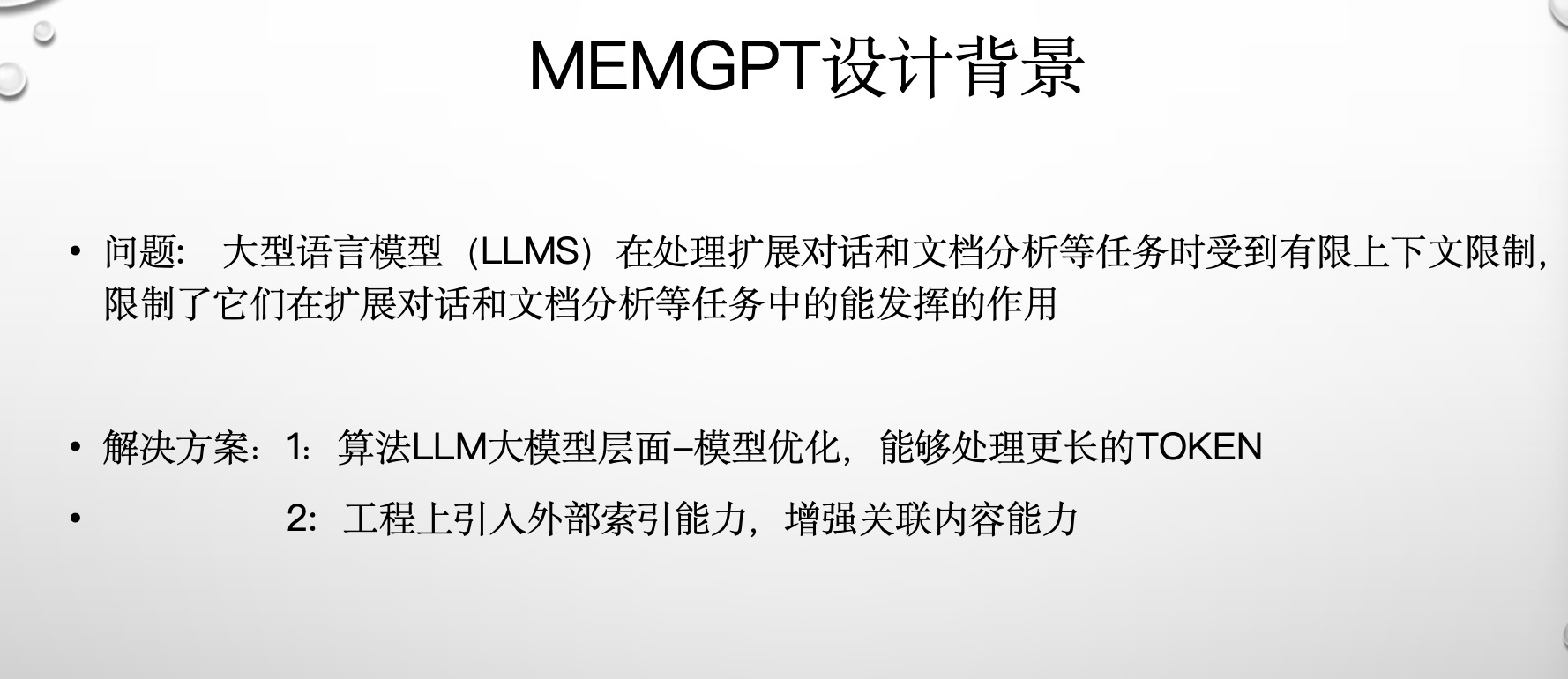

MemGPT 的设计灵感来自传统操作系统的层次内存管理,它能够在“内存”(类似于操作系统中的内存)和外部存储之间移动信息。MemGPT 管理内存管理、LLM 处理模块和用户之间的控制流。这种设计允许在单个任务中进行重复的上下文修改,使代理能够更有效地利用其有限的上下文。

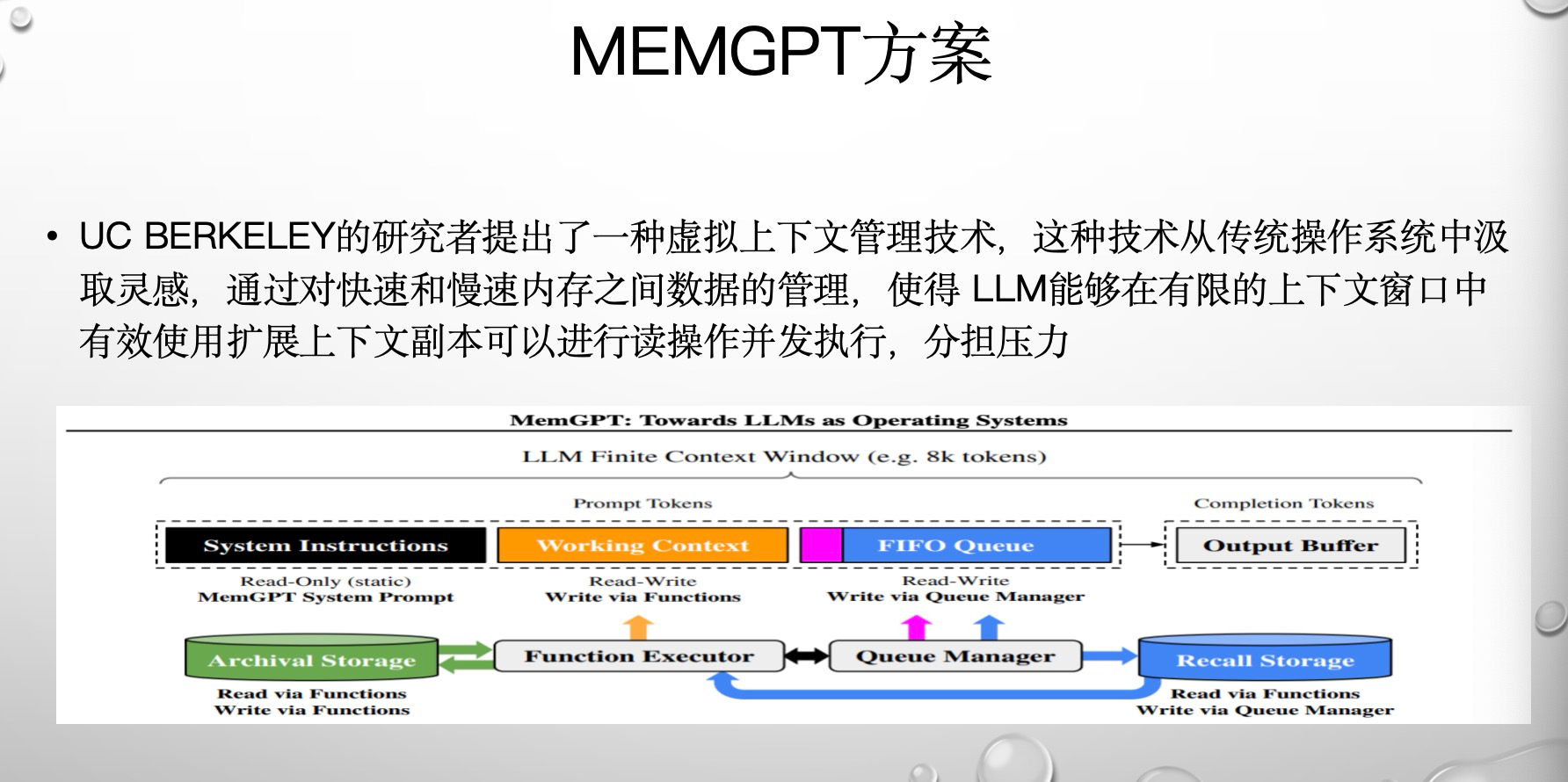

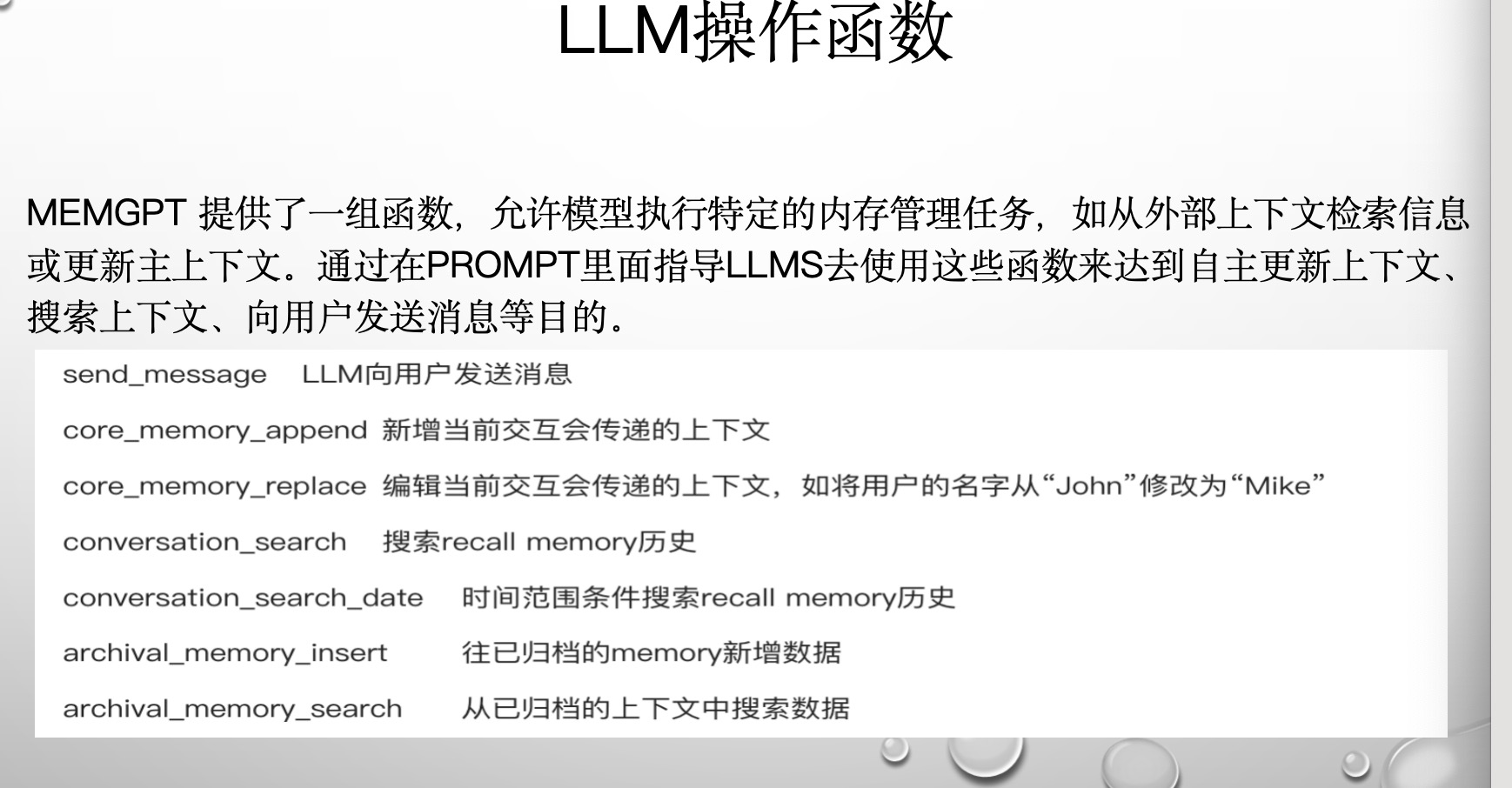

memgpt使用 system+core memory + history方式 拼接成prompt请求llm,同时让llm返回是否触发function,给用户发送消息就是send_message, 自己更新core memory 就是 core_memory_append replace.

同时memgpt将聊天记录,存储到db中,当当前prompt里面不包含部分历史信息,由llm自己主动请求,conversation search,并将搜索结果更新到prompt、和 core memory中,从而实现大规模、大时间跨度的历史信息关联。

memgpt 更使用agent,用llm智能方式,主动更新memory,主动将memory进行分层控制,从而拥有超长信息能力。